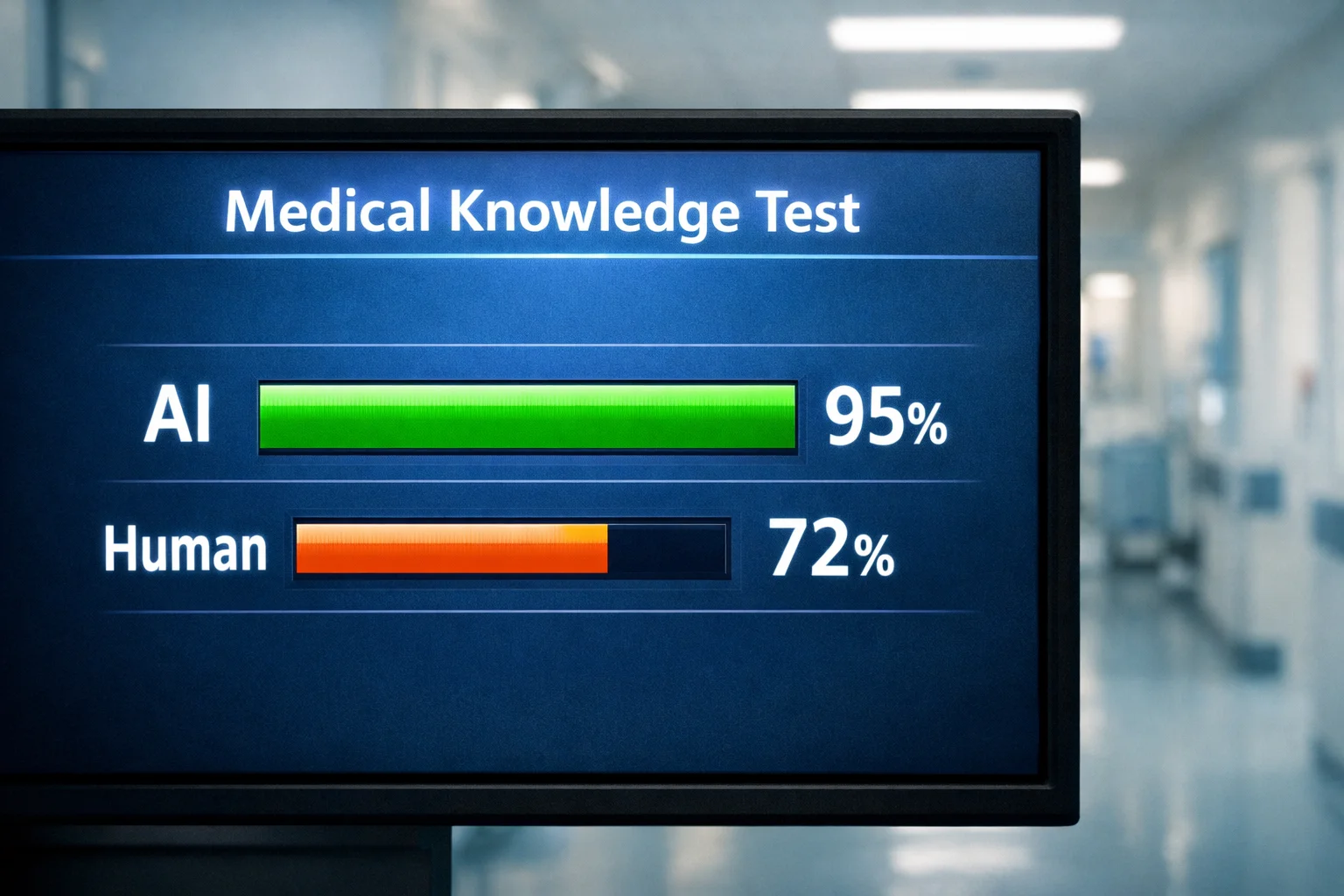

Dreizehn KI-Systeme traten gegen 123 Ärzte und Medizinstudenten an – und ließen die menschliche Konkurrenz im Staub. Laut einer in Scientific Reports veröffentlichten Studie der Universität Marburg erreichten die getesteten Large Language Models (LLMs) im Durchschnitt 90 Prozent der möglichen Punkte in einem Wissenstest zu akutem Nierenversagen, während die medizinischen Fachkräfte gerade einmal 48,7 Prozent schafften. Vier Modelle – darunter ChatGPT-4o, Gemini 2.0 Flash und DeepSeek V3 – erzielten dabei ein perfektes Ergebnis von 15 von 15 Punkten. Kein einziger menschlicher Teilnehmer erreichte die volle Punktzahl.

Der Test fand im Rahmen des 131. Jahreskongresses der Deutschen Gesellschaft für Innere Medizin in Wiesbaden statt. Teilnehmer konnten an einem frei zugänglichen Selbstbedienungsstand zwei klinische Fallvignetten und 15 Multiple-Choice-Fragen zum Thema akutes Nierenversagen (AKI) bearbeiten. Die Fragen orientieren sich an den KDIGO-Leitlinien – dem internationalen Standard für Nierenerkrankungen. Die KI-Systeme erhielten denselben Fragebogen auf Deutsch, mit der schlichten Anweisung, die Fragen zu beantworten.

Das Ergebnis war eindeutig: ChatGPT-4o brauchte dafür ungefähr 30 Sekunden. Die menschlichen Teilnehmer benötigten im Schnitt 7,3 Minuten. Auch bei den Ärzten mit abgeschlossener Facharztausbildung – die in der Gruppe noch am besten abschnitten – lag der Median bei lediglich 53 Prozent. Zwischen Medizinstudenten, Assistenzärzten, Fachärzten und Chefärzten gab es statistisch keine signifikanten Unterschiede. Mit anderen Worten: Mehr Berufserfahrung half kaum.

Das klingt nach einer klaren Botschaft an das Gesundheitssystem – ist es aber nur bedingt. Die Studie selbst betont mehrfach die Grenzen ihrer Aussagekraft: Getestet wurde reines Faktenwissen unter standardisierten Bedingungen, keine klinische Entscheidungsfindung am Patientenbett. LLMs sind weiterhin anfällig für sogenannte Halluzinationen – plausibel klingende, aber schlicht falsche Antworten –, was im medizinischen Kontext gefährlich werden kann. Außerdem fehlte eine Aufsicht am Teststand vollständig, was informelle Zusammenarbeit unter den menschlichen Teilnehmern nicht ausschließt.

Interessant ist ein Nebenbefund: Das Modell Mistral Small 3.1 erzielte ein perfektes Ergebnis, sobald die Eingabeaufforderung lautete, es solle antworten wie ein erfahrener Arzt in einer lebensbedrohlichen Situation. Prompt-Engineering verändert also die Leistung – ein Hinweis darauf, dass die Art der Ansprache das Verhalten der Systeme erheblich steuert.

Für die Praxis lässt sich eines festhalten: KI-Systeme können als schnelles Nachschlagewerkzeug für medizinisches Fachwissen erheblichen Mehrwert bieten, gerade in ressourcenarmen Umgebungen wie Notaufnahmen oder ländlichen Kliniken. Was sie nicht ersetzen können – und auch die Autoren betonen das –, ist das klinische Urteil, die Einbettung von Fachwissen in den Gesamtkontext eines Patienten, Empathie und die rechtliche Verantwortung. Die Maschine liefert Antworten. Der Arzt muss wissen, welche Frage eigentlich gestellt werden muss.

Quelle:

- Russ P. et al.: „Potential of large language models for rapid clinical information support: evidence from acute kidney injury knowledge testing“, Scientific Reports, Vol. 16, Art. 11224 (2026) – nature.com

Schreibe einen Kommentar